Violência psicológica com uso de IA já é considerada um agravante legal no Brasil. E, acima de tudo, se tornou uma resposta direta aos novos riscos criados pela tecnologia. A promulgação da Lei 15.123/2025 insere uma causa de aumento de pena no artigo 147-B do Código Penal, reconhecendo que práticas como deepfakes, manipulação de voz e montagens digitais têm poder destrutivo comparável ao de outras formas de agressão física e emocional.

O que é violência psicológica com uso de IA e por que ela é tão perigosa?

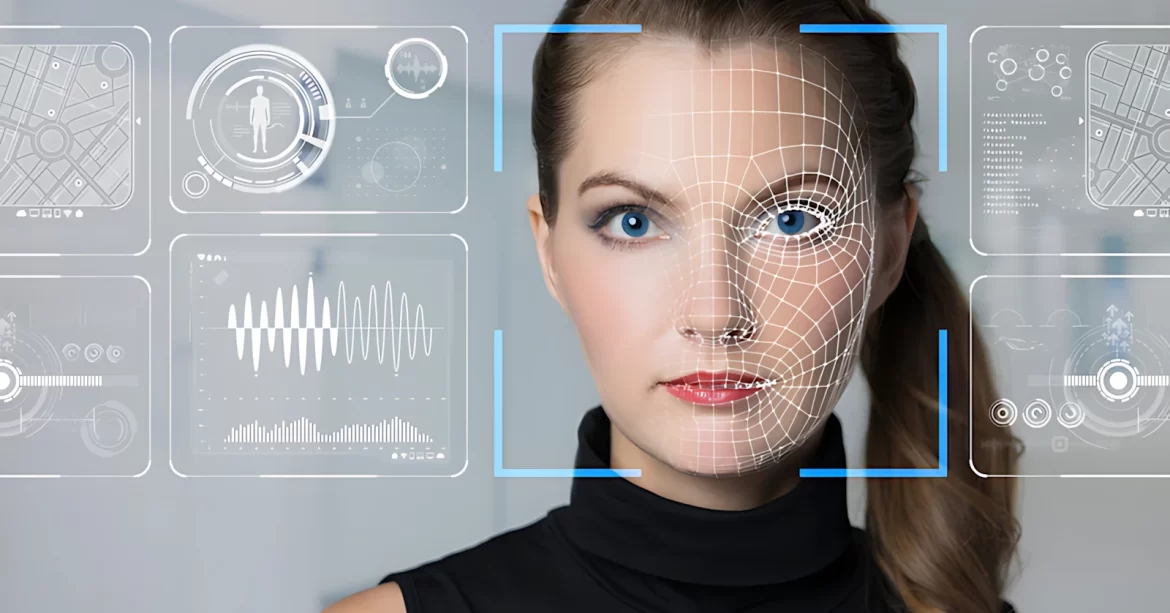

Primeiramente, é importante entender como a inteligência artificial pode intensificar a violência psicológica. Deepfakes, por exemplo, permitem a criação de vídeos hiper-realistas com imagens e vozes manipuladas, fazendo parecer que uma pessoa disse ou fez algo que, na verdade, nunca aconteceu. Do mesmo modo, agressores usam áudios adulterados, montagens visuais e ferramentas de IA que simulam conversas para humilhar, ameaçar, isolar ou manipular emocionalmente a vítima.

Além disso, essas tecnologias permitem que o agressor atue de forma anônima, o que dificulta a identificação e intensifica o sentimento de impotência da vítima. Ou seja, a violência digital deixa marcas que não são visíveis, mas que ferem profundamente.

O que diz a nova Lei 15.123/2025 sobre o uso de IA em crimes psicológicos?

O Congresso sancionou a Lei nº 15.123/2025 em abril e publicou o texto legal entre abril e maio de 2025. Ela altera o artigo 147-B do Código Penal — dispositivo que trata especificamente da violência psicológica contra a mulher. O texto legal agora inclui o seguinte parágrafo:

“Parágrafo único. A pena é aumentada de metade se o crime for praticado com uso de inteligência artificial ou de qualquer outro recurso tecnológico que altere imagem ou som da vítima.”

Consequentemente, quando há comprovação de uso de IA para manipular elementos audiovisuais com o intuito de causar dano psicológico, a pena base de 6 meses a 2 anos de reclusão sobe automaticamente para 9 meses a 3 anos.

Por que essa mudança legislativa sobre Violência psicológica com uso de IA é tão relevante?

Antes de tudo, a nova lei reconhece que os danos causados pela manipulação digital não são menores ou menos sérios do que os provocados por formas tradicionais de violência. Em outras palavras, trata-se de uma resposta jurídica a um fenômeno que já é cotidiano nas redes sociais e aplicativos de mensagens.

Além disso, o uso banalizado de ferramentas de IA para fins ilícitos mostra que essas práticas estão ao alcance de qualquer pessoa com acesso à internet. Softwares gratuitos permitem criar deepfakes com facilidade. Logo, a legislação precisava se atualizar para acompanhar esse novo cenário.

Por fim, o aumento da pena atua como mecanismo punitivo e preventivo. A nova lei sinaliza à sociedade que tratará com rigor o uso de IA para ferir emocionalmente alguém.

Como funciona a aplicação prática da nova causa de aumento?

Atualmente, a aplicação da nova lei exige um esforço coordenado entre os órgãos de segurança pública, Ministério Público e o Judiciário. Veja como isso se dá na prática:

Na investigação policial: será necessário coletar provas digitais que comprovem a manipulação de imagem ou som. Isso inclui arquivos originais, perícias técnicas, análises de metadados e outros elementos que demonstrem a adulteração feita com IA.

Na denúncia pelo Ministério Público: o promotor deverá indicar com clareza que o crime envolveu o uso de IA ou outro recurso tecnológico, justificando assim o pedido de aumento de pena com base no parágrafo único do art. 147-B.

Na sentença judicial: o juiz aplicará a majorante de forma vinculada, ou seja, será obrigado a aumentar a pena em 50% caso fique comprovado o uso de tecnologia para manipulação audiovisual da vítima.

Exemplo prático sobre Violência com uso de IA: o caso de Cícera

Imagine que Cícera encontra um vídeo circulando nas redes sociais. Nele, sua imagem aparece em um conteúdo pornográfico, mas trata-se de uma deepfake — um vídeo adulterado com uso de IA. Ela descobre que seu ex-companheiro foi o responsável pela divulgação.

Nesse cenário:

- Cícera registra um boletim de ocorrência por violência psicológica;

- A polícia apreende o vídeo e realiza perícia digital;

- O Ministério Público oferece denúncia com base no art. 147-B e requer o aumento de pena;

- O juiz reconhece o agravante e aplica a pena aumentada.

Quais os desafios para aplicar a nova legislação?

Apesar da relevância da nova norma, sua efetividade ainda depende de alguns fatores estruturais. Antes de tudo, vale destacar que a prova técnica é indispensável. Ou seja, sem perícia digital especializada, é impossível comprovar o uso de IA, o que pode inviabilizar a aplicação da causa de aumento.

Além disso, o alcance da norma é limitado. A lei abrange apenas os casos em que há alteração de imagem ou som. Portanto, outras formas de violência digital com IA — como uso de robôs para assédio, disseminação de fake news, criação de perfis falsos ou mensagens automatizadas com conteúdo ofensivo — ainda ficam de fora.

Outro ponto importante é a integração com políticas públicas. A nova lei atua no campo repressivo, mas para proteger efetivamente as vítimas é necessário investir em centros de perícia digital, campanhas de conscientização, apoio psicológico e canais ágeis para remoção de conteúdo ofensivo da internet.

Concluindo,

Por fim, a Lei 15.123/2025 é um avanço significativo no combate à violência psicológica com uso de IA. Com isso, o ordenamento jurídico brasileiro passa a reconhecer que agressões digitais são tão graves quanto as físicas — e merecem tratamento rigoroso.

Ou seja, a majoração da pena não apenas pune, mas também desestimula o uso irresponsável da tecnologia para fins criminosos. Portanto, operadores do Direito, peritos, autoridades policiais e a sociedade na sua totalidade devem garantir a aplicação efetiva dessa legislação. Afinal, a proteção das vítimas — especialmente das mulheres — deve continuar sendo prioridade absoluta em tempos de inteligência artificial.

Perguntas e respostas sobre o tema Violência Psicológica com uso de IA

1. Como diferenciar manipulação digital simples de deepfake em um processo penal?

A princípio, a perícia técnica é o único meio eficaz para diferenciar alterações básicas de edições profundas geradas por IA. Deepfakes utilizam redes neurais para simular expressões. Bem como, voz e movimentos com realismo elevado, o que exige exames minuciosos para serem identificados.

2. A vítima precisa provar que sofreu abalo psicológico?

Sim. Apesar da alteração de imagem ou som ser elemento técnico, o tipo penal exige que a vítima tenha sofrido violência psicológica. Ou seja, depoimentos, laudos psicológicos e consequências concretas, como afastamento do trabalho ou uso de medicamentos, reforçam a prova do dano.

3. Em quais situações o uso de IA não aumenta a pena?

Caso a IA seja utilizada apenas para automatizar mensagens ofensivas, criar textos falsos ou movimentar bots, sem alteração direta de imagem ou som da vítima, a causa de aumento prevista na Lei 15.123/2025 não se aplica. Nesses casos, outras figuras penais podem ser usadas.

4. O juiz pode deixar de aplicar o aumento mesmo se houver prova do uso de IA?

Não. A redação da lei torna a aplicação da causa de aumento obrigatória sempre que estiver comprovado o uso de tecnologia para alterar imagem ou som da vítima. Ou seja, trata-se de um agravante de natureza vinculada.

5. Como garantir que a prova digital seja aceita em juízo?

A coleta deve respeitar a cadeia de custódia prevista no Código de Processo Penal. Além disso, os arquivos devem ser analisados por peritos oficiais e acompanhados de laudo técnico detalhado, com descrição clara do uso de IA e seus efeitos sobre o conteúdo original.

6. A nova lei vale apenas para casos envolvendo mulheres?

Sim. O art. 147-B do Código Penal trata exclusivamente de violência psicológica contra a mulher, com base na Lei Maria da Penha. Portanto, o agravante por uso de IA também está restrito a esse contexto, não alcançando vítimas do sexo masculino ou outros gêneros.

7. A responsabilização é possível mesmo sem divulgação do conteúdo adulterado?

Depende. Se o conteúdo manipulado com IA tiver sido utilizado apenas como forma de ameaça direta ou chantagem, ainda assim poderá configurar violência psicológica. Contudo, a análise do caso concreto será essencial para identificar o dano causado.

8. Ferramentas de detecção automática de deepfake têm valor jurídico?

Atualmente, essas ferramentas podem orientar investigações, mas não substituem a perícia oficial. Para produzir efeito jurídico válido, é necessário que um perito habilitado confirme a autenticidade da detecção e integre essa análise ao processo penal.

Somos Hubert & Carvalho, Escritório de Advocacia em Florianópolis

↗️ Siga no Instagram @hubertecarvalho

📧 Clique e entre em contato

📱 (48) 991829050